Kit de Recursos SEO — Descarga gratis

Plantillas + checklists + guíasLa estructura de una web, suele ser un concepto que comúnmente se entiende como algo técnico y de entrada no se le da mucho valor en términos de posicionamiento SEO, pero si se entiende y se elabora de forma correcta puede ofrecerte muy buenos resultados.

Para ello, debemos tener claro la importancia de cada una de nuestras páginas. Si una página de nuestra web es importante para nosotros, también lo será para Google. La forma en la que Google entiende esta importancia, es insertando más enlaces, es decir, cuando más páginas hablan de otra, significa que esta tiene mayor importancia que el resto.

Una vez entendido este concepto, vamos a ver qué son las estructuras web y por qué son tan importantes.

Índice

- 1 ¿Qué es la estructura web?

- 2 ¿Qué herramientas y elementos de código usamos para controlar la estructura de una web?

- 2.1 Robots

- 2.2 Herramientas de crawleo

- 2.3 Herramientas de seguimiento y analítica

- 2.4 Herramienta de estructura de enlaces

- 2.5 Herramientas para ver páginas más enlazadas internamente y su fuerza

- 2.6 Herramientas para ver si ranquean urls en Google

- 2.7 Herramientas de cruce de datos

- 2.8 Herramientas de análisis de logs

- 3 Tipos de arquitectura web

- 4 ¿Cómo utilizar una arquitectura web en una estrategia de SEO?

- 5 Conclusiones

¿Qué es la estructura web?

La estructura web, es la forma en la que está organizada una web mediante su enlazado interno, y mediante la cual, reparte su autoridad a sus páginas internas.

La estructura interna de los enlaces de una web es muy importante, ya que, la página con más fuerza de nuestra web (normalmente la home), repartirá su fuerza y autoridad de enlaces externos al resto de páginas.

Linkjuice: traspasa fuerza a tus otras páginas

El Linkjuice es la fuerza que pasamos de una página a otra mediante enlaces. La fuerza de una página se divide en el número de enlaces salientes, y a cada una de ellas, se les deriva un valor de Linkjuice.

Veamos en profundidad cómo se reparte la fuerza de una página y se reparte entre las páginas enlazadas.

¿Cómo se reparte la autoridad en la estructura de una web?

En cada página, la autoridad se divide en función de los enlaces salientes y da como resultado esta fuerza de enlazado denominada Linkjuice. Los enlaces de una web producen cadenas de enlaces y cada página enlaza a otras, es por ello que cada vez es menor la fuerza que pasa de una página a otra, es decir:

Home -> Página 1 -> Página 3

-> Página 4

-> Página 2

La home pasará un 50% de su fuerza (conocida como Linkjuice) a la página 1 y a la página 2, mientras que la página 1, pasará un 50% de su Linkjuice, equivalente a un 25% del Linkjuice de la home. El gráfico quedaría algo así en porcentajes de Linkjuice (fuerza de enlazado):

100% -> 50% -> 25%

->25%

->50%

Realmente el cálculo de la fuerza de enlazado no es exáctamente así, esto solo es un ejemplo para que se entienda que por cada enlace, la fuerza que traspasa es mejor. Actualmente no se conoce cómo se calcula la fuerza de enlazado, aunque sí se conoce la fórmula empleada inicialmente por Google siendo esta muy compleja.

Es por este motivo, que siempre se recomienda que una web permita llegar a cualquier página mediante 3 clics, ya no solo por usabilidad y comodidad para el usuario, también para facilitar el crawleo de nuestra web.

🔎 Podría interesarte: 👉 Claves para conseguir mejorar la accesibilidad de tu web.

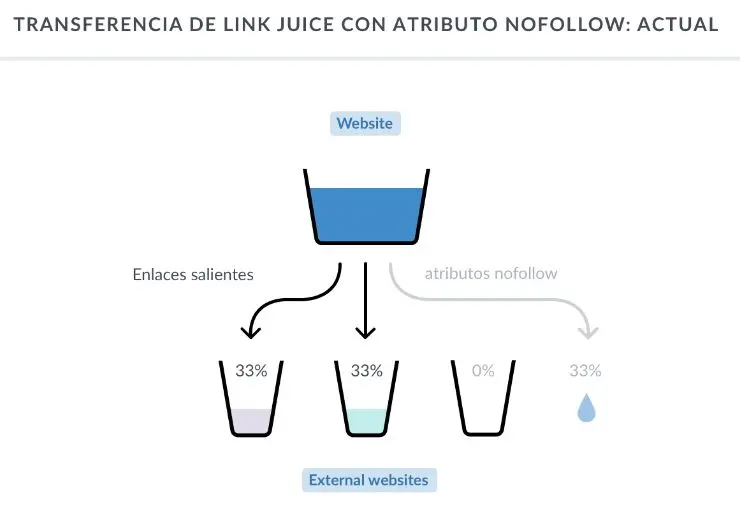

Cómo influyen los enlaces nofollow en una web

Los enlaces nofollow de nuestra web, hacen que la fuerza de enlace se pierda y no vaya a ningún sitio, es por ello que siempre es preferible no tener enlaces en nofollow:

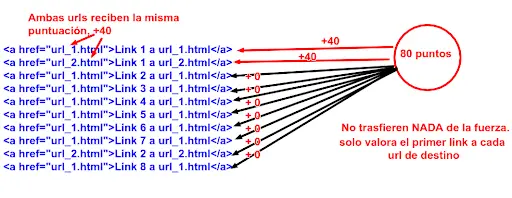

Datos a destacar de los enlaces a una página

Además de tener conocimientos sobre cómo se reparte la fuerza entre los enlaces de tu web y de conocer cómo afectan los enlaces nofollow a la tu web, es importante tener en cuenta que, cuando se tienen varios enlaces hacia una misma página dentro de una página concreta, solo da fuerza uno de los enlaces, el resto que están repetidos, no aportaran Linkjuice. Ejemplo gráfico:

¿Qué herramientas y elementos de código usamos para controlar la estructura de una web?

Como es evidente, no siempre nos va a interesar todas las urls de una página web, es por ello que existen diferentes utilidades y herramientas para ayudarnos a decidir, además de impedir, que estas páginas se indexen.

Las herramientas presentadas a continuación, no solo nos ayudarán a cómo ver la estructura de una página web, si no también nos ayudarán a tomar las decisión más correcta en cuanto qué hacer con cada url o cada conjunto de urls, algo muy importante en la arquitectura web seo.

Robots

Algo que no debe faltar es la configuración de los robots de Google. Estos robots se pueden controlar principalmente de dos formas:

- Robot.txt o configuración de htaccess

- Meta etiqueta robots

Controlar los robots ayudará a que el robot únicamente pase e indexe las páginas que nos interesan.

Es importante recordar que, si no nos interesa que Google detecte una url, siempre será mucho mejor eliminarla, siempre y cuando sea posible.

NOTA: La página de carrito o el checkout de una tienda online, no nos interesa posicionarla, pero tampoco eliminarla.

Una url que abre una ventana y es una imagen más grande, esto nos interesa posicionarlo y podría llegar a intentar eliminarlo.

Herramientas de crawleo

Para conocer bien qué páginas nos interesa posicionar y cuáles no, previamente hay que hacer o un estudio de palabras clave, definir las páginas que se van a necesitar para el proyecto y cómo se van a enlazar entre estas, o en caso de ya estar creada la web, revisar esta estructura web mediante herramientas de crawleo, es decir, bots:

- Screaming Frog

- Sitebulb

- Oncrawl

- Seotools for excel

- Netpeak Spider

Herramientas de seguimiento y analítica

Existen también herramientas de analítica que pueden ayudarnos a detectar algunas páginas que pueden estar indexándose o por las cuáles los robots de Google están pasando y no están posicionando, como:

- Google Analytics: Filtrando con tráfico orgánico podemos ver las urls que tienen visitas de buscadores. También pueden usarse otras herramientas de analítica para esto.

- Search console: La versión nueva proporciona mucha más información de esto, ya que nos muestra páginas que están en noindex y el robot a rastreado, páginas que están sin posicionar, etc.

Herramienta de estructura de enlaces

Las siguientes herramientas nos facilitan ver de forma gráfica cómo están construidos los enlaces y cómo se enlazan las páginas entre ellas.

- Cognitive SEO

- Fandangoseo

- Screaming Frog

- Sitebulb

Herramientas para ver páginas más enlazadas internamente y su fuerza

- Ahrefs: información de las páginas más enlazadas y más fuerza de enlace

- Excel: importando datos y aplicando fórmulas puedes hacer tus propios cálculos automáticamente e ir probando a modificar enlaces para ver cómo se repartiría esta autoridad, aunque es bastante complejo.

- Open site explorer: nos da información sobre la fuerza de cada página

- Netpeak Spider y Safecont: son dos herramientas que valora la fuerza de cada una de las páginas en función de los enlaces internos. Screaming Frog también puede hacer esto desde la versión 10

Herramientas para ver si ranquean urls en Google

Esto puede sernos útil para detectar si existen tipologías de urls que están posicionando en Google o están indexadas pero apenas nos aportan tráfico.

Por tipologías de url, nos referimos a urls que pertenecen a un conjunto de urls dentro de una web, como artículos de una categoría, productos de una categoría, etc.

En este caso, es conveniente ver si pueden aprovecharse y posicionarse, o nos interesa más eliminar todas estas urls, para mejorar la frecuencia de rastreo sobre otras páginas que pueden mejorar la posición media de sus palabras clave, y aportarnos más tráfico en consecuencia.

Para esto, es necesario revisar las palabras clave por las cuales posicionan o deberían posicionar y calcular aproximadamente, cuánto tráfico podría traernos en base al promedio de búsquedas. Existen varias herramientas que realizan esto, entre ellas:

- Google analytics

- Semrush

- Ahrefs

- Sistrix

- Cognitiveseo

Por ejemplo, si tenemos más de 20 páginas que no posicionan y tienen una misma tipología, este conjunto no interesará posicionarlo seguramente o tocará revisar que está sucediendo y si realmente nos interesa posicionar estas páginas.

Herramientas de cruce de datos

Las herramientas de cruce de datos nos facilita mucho la toma de decisiones, por lo que puede ser útil si contamos con varias herramientas y queremos analizar los enlaces entrantes y la valoración de estos enlaces, así como otros datos.

- URL profiler

Esta herramienta nos permite conectarnos vía API y a muchas otras herramientas y exportar toda la información ya cruzada en un excel.

- Excel

Es la herramienta por excelencia que casi todo el mundo usa para cruzar datos. Por 3 motivos: es fácil de manejar, cuenta con mucho soporte en la red y no es necesario programar en una gran mayoría de casos.

También existen complementos que ayudan a realizar las tareas de importar la información. Con un par de fórmulas, puedes unificar la información extraída de varias fuentes y compararla.

Herramientas de análisis de logs

Las herramientas de análisis de logs nos indican la navegación de los diferentes robots y usuarios sobre nuestra web, además de obtener datos sobre posibles errores 400, 500 o redirecciones.

- Excel

- Screaming frog log analyzer

- Oncrawl

Existen más herramientas, pero la más asequible en relación calidad/precio sería Screaming Frog Log Analyzer.

La posibilidad de ver las urls más rastreadas te permitirá tener información, hacerte preguntas y contrastar la información: ¿Cuál es la url más rastreada por los robots de búsqueda?, ¿Realmente queremos que sea la más rastreada?, ¿Está posicionando esa url?, ¿Cuánto tráfico nos aporta?, ¿Los usuarios que llegan a esa pagina realizan el objetivo que queremos?….

Respondiendo a estas preguntas, en base a la información extraída de los logs, podemos replantearnos la estructura de nuestra web y los enlaces internos.

Tipos de arquitectura web

Existen varios tipos de arquitectura web con los que la mayoría de expertos trabajan. Suelen ser bastante fáciles, aunque según el sector, estas estructuras pueden variar y llegar a ser bastante más complejas.

Estas estructuras dependen de la estrategia de cada negocio y no todas serán siempre igual, pero ayudan a partir desde una base por la cual empezar conocer algunas de estas estructuras básicas.

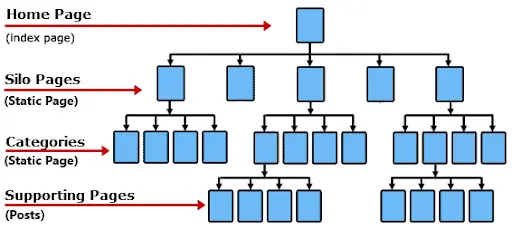

Estructura silo

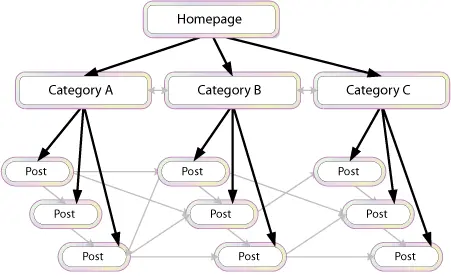

La estructura de silo es una arquitectura ramificada donde los enlaces van de arriba a abajo y viceversa. Las páginas de un mismo nivel solo se pueden enlazar entre ellos si se encuentran dentro de un mismo grupo.

Estructura mixta

Este tipo de estructura es bastante similar a la anterior, pero no tiene la restricción anterior, cualquier página puede enlazar a las otras.

Estructura de clusters

La estructura de enlaces mediante clusters suele ser un mega contenido con sentido amplio para posicionar por keywords más complejas, el cual enlaza a otros contenidos más específicos para posicionar a otras keywords long tail, y estos a su vez, enlazan a este megacontenido.

Lo que pretenden es reforzar la temática y el significados interno de cada grupo de enlaces mediante la clasificación de contenidos en clusters de contenidos

¿Cómo utilizar una arquitectura web en una estrategia de SEO?

Una vez ya hemos visto todas las herramientas y hemos visto algunos ejemplos de estructuras de enlaces, vamos a empezar a crear una arquitectura web.

Arquitectura web desde 0

En una arquitectura web hay que tener en cuenta si la página va ir orientada a:

- Servicios

- Blog

- Venta de enlaces

- Tienda online

- Afiliados

- Otros tipos de webs

Cada una de estas webs tendrá una estructura distinta y, según la cantidad de páginas existentes, trataremos de enlazar la mayor cantidad de estas entre ellas mismas (arquitectura mixta), o trataremos de crear una estructura más ramificada (arquitectura silu) en caso de que la web sea muy grande.

Siempre se puede partir inicialmente de una arquitectura silu, para después pasar a una mixta, reforzando con enlaces las secciones más flojas a nivel de enlazado interno.

Para entender esto mejor, pondré un ejemplo. Las páginas de servicios, destinadas a capturar leads o de afiliados, suelen ser webs con pocas páginas, por lo que se intenta que todas estén entrelazadas entre ellas.

Las páginas de tiendas online o revistas, suelen acumular demasiado contenido con el paso de tiempo, por lo que es mejor una estructura ramificada o no transmitiremos bien la fuerza a los contenidos más importantes.

Además, en el caso de las tiendas online, lo que se pretende es dar más fuerza a las categorías, ya que, normalmente son las que más se buscan, y los productos son mucho más fáciles de posicionar y no requieren mucho esfuerzo para alcanzar las primeras posiciones en Google.

Arquitectura web ya creada

En una arquitectura web que ya está planteada y no podemos estructurarla nosotros mismos, debemos moldearla y realizar un estudio de todas las urls de la web.

Para ello, es importante extraer las urls por las que pasa el crawler de Google mediante los logs. Analizando los logs podemos saber cuántas veces pasa Google por las urls de nuestra web, además de poder comparar este dato con el tráfico que nos trae desde Google gracias a herramientas como Search Console y Google Analytics.

Es importante no olvidar, que también deberemos revisar el enlazado externo de la web y conocer cuáles son las urls más enlazadas, tanto a nivel interno como externo.

El cruce de datos podemos hacerlo gracias a excel y su función avanzada de tablas dinámicas o utilizar fórmulas para ello.

Una vez hemos analizado cómo está la arquitectura web actual, las urls que indexan, las que no, así como las que posicionan y las que no, toca reestructurar todo el enlazado interno.

Al reestructurar la web, seguramente existirán urls que eliminemos ya que no serán necesarias, o decidamos desindexar.

Si decidimos eliminar, no hay que olvidar que hay que hacer redirecciones 301 por cada página eliminada, a una página similar o a la categoría superior donde se encuentra esta. Sí que existirán casos (si son muchas urls sin enlaces o que no exista nada similar), que nos interesará desindexar las páginas directamente.

Si por el contrario, decidimos desindexar, pasamos a noindex y conforme pase el tiempo, luego bloqueamos la url mediante el fichero robots.txt. Existen dos alternativas más:

- Desindexar desde Search Console las urls y bloquear desde robots

- Bloquear desde robots.txt directamente la url, pero Google tardará más tiempo en desindexar la página.

Conclusiones

Una vez tienes todos estos conocimientos, debes saber que no hay que tomarse todo al pie de la letra, siempre es mejor probar y experimentar para ver la evolución en Google de los diferentes tipos de estructura y ver cuál se adapta mejor a tu web.

Al final, en el SEO, lo que mejor funciona, es la experiencia y el ensayo error. Con tiempo y pruebas, lograrás aprender bastante y podrás descubrir muchas cosas sobre lo que funciona realmente.

En agenciaSEO.eu somos experto en la definición de estructuras web. ¿Quieres que te ayudemos con tu estructura web? La creamos de cero o remoldeamos la existente, ya es hora de que comiences a posicionar en los primero puestos de Google. Contacta con nosotros y te diremos cómo.